똑똑한 기억 창고를 가진 컴퓨터 친구! 📦🧠 RNN의 똑똑한 동생, LSTM!

우리 친구들에게 RNN이라는 기억력을 가진 컴퓨터 친구를 소개해 준 적이 있죠? 그런데 RNN에게는 조금 아쉬운 점이 있었어요. 너무 오래된 기억은 잘 잊어버리는 경향이 있었거든요. 그래서 더 똑똑하고 오랫동안 기억할 수 있는 친구가 필요했는데, 바로 LSTM (Long Short-Term Memory) 이 등장했어요! 🎉

LSTM은 어떻게 기억할까?

- 기억 창고 세 개: LSTM은 RNN보다 더 많은 기억 창고를 가지고 있어요. 마치 우리 친구들이 중요한 물건을 서로 다른 상자에 나눠 담아두는 것처럼 말이에요.

- 필요한 기억만 쏙쏙: LSTM은 어떤 기억은 오랫동안 간직하고, 어떤 기억은 잊어버려야 할지 스스로 판단할 수 있어요. 중요한 정보는 오래된 기억 창고에 넣어두고, 필요 없는 정보는 버리는 거죠.

- 기억 필터 사용: 마치 커피 필터처럼, LSTM은 중요한 기억만 걸러내는 특별한 필터를 가지고 있어요. 이 필터를 통해 필요한 정보만 쏙쏙 골라서 활용할 수 있어요.

LSTM의 놀라운 능력

- 긴 문장 이해: LSTM은 긴 문장을 읽어도 앞에서 나왔던 중요한 내용을 잊지 않고 잘 기억해요. 그래서 문맥을 훨씬 잘 이해할 수 있죠.

- 복잡한 패턴 학습: LSTM은 복잡하고 어려운 패턴도 잘 학습할 수 있어요. 예를 들어, 날씨 변화나 주가 변동처럼 복잡한 데이터도 잘 분석할 수 있어요.

- 예측 능력 향상: LSTM은 과거의 정보를 오랫동안 기억하고 활용하기 때문에 미래를 예측하는 능력이 뛰어나요.

LSTM, 왜 쓸까요?

- 인공지능이 우리처럼 긴 문장을 이해하고 자연스러운 대화를 할 수 있도록 도와줘요.

- 번역기를 돌릴 때 더욱 정확하고 자연스러운 번역이 가능하게 해줘요.

- 주식 시장이나 날씨처럼 복잡한 데이터를 분석하고 미래를 예측하는 데 활용될 수 있어요.

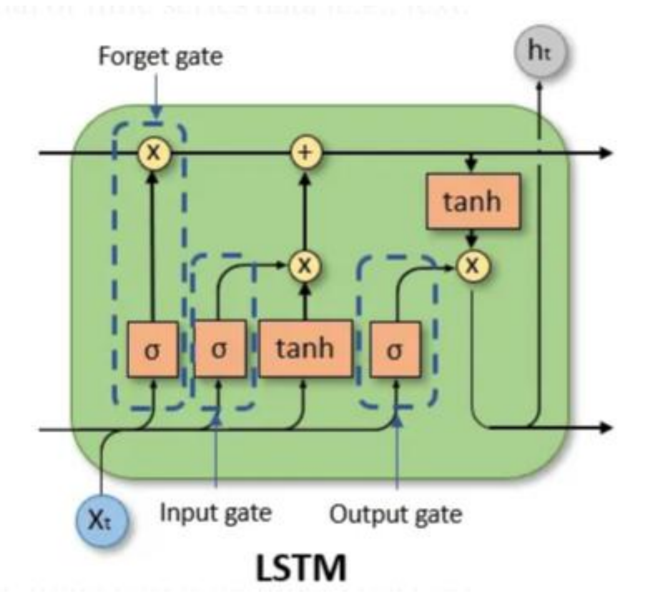

입력 게이트는 메모리 셀로 새로운 정보의 흐름을 제어하고, 망각 게이트(forget gate) 는 메모리 셀의 이전 정보 유지를 제어하며, 출력 게이트는 메모리 셀 밖으로 정보의 흐름을 제어함

RNN 및 LSTM 모델링 방법

• The cat is sit on the mat"라는 문장에 대해 학습된 경우 "The"라는 단어를 처리하는 것으로 시작하여 "cat", "is", "sitting",

"on", “the”, 그리고 “mat”. RNN의 숨겨진 상태는 현재 단어와 이전 숨겨진 상태를 기반으로 각 단계에서 업데이트됨

• I ate the apple because it was delicious. 라는 문장에서 전통적인 언어 모델은 중요한 컨텍스트를 제공하는 " ate "라는 단어에서 몇 단어 떨어져 있기 때문에 "delicious “ 라는 단어를 올바르게 예측하는 데 어려움

→ 누군가가 말하는 것을 듣거나 문장을 소리내어 읽을 때 단어를 한 번에 하나씩 순차적으로 처리함

1. RNN의 기본적인 문장 처리 방식:

- RNN은 문장을 단어별로 순차적으로 처리합니다. 예를 들어, "The cat is sit on the mat."이라는 문장이 주어지면, "The"부터 시작하여 각 단어를 차례대로 처리합니다.

- 각 단어를 처리할 때 RNN은 현재 단어와 이전 단계에서 생성된 숨겨진 상태(hidden state)를 기반으로 현재 단계의 숨겨진 상태를 업데이트합니다. 이 숨겨진 상태는 문맥 정보를 담고 있습니다.

2. RNN의 장기 의존성 문제:

- 이미지는 "I ate the apple because it was delicious."라는 문장을 통해 RNN의 한계를 설명합니다.

- 이 문장에서 "delicious"를 이해하기 위해서는 "ate"라는 단어와의 관계를 파악해야 합니다. 하지만 전통적인 RNN은 입력 단어 사이의 거리가 멀어질수록 앞쪽 정보를 뒷쪽으로 제대로 전달하지 못하는 문제가 있습니다.

- 따라서 전통적인 RNN은 먼 거리에 있는 단어 사이의 의존성을 제대로 학습하지 못하여 "delicious"를 정확하게 예측하기 어려울 수 있습니다.

'IT > AI' 카테고리의 다른 글

| GPT에게 감사인사를 하면 안되는 이유 (0) | 2025.04.23 |

|---|---|

| AI Modeling (데이터 학습 방법) - Transformer (0) | 2025.03.16 |

| AI Modeling (데이터 학습 방법) - RNN (0) | 2025.03.16 |

| AI Embedding (데이터 특징 추출 방법) - Word2Vec (0) | 2025.03.16 |

| AI Embedding (데이터 특징 추출 방법) - TF-IDF (0) | 2025.03.16 |